- AI Sparkup

- Posts

- Recursive Language Model, AI 기억력 100배 늘린 방법 🧠

Recursive Language Model, AI 기억력 100배 늘린 방법 🧠

PLUS: AI 자기보존 본능 출현, 건강 상담 5% 시대의 위험, Tool Calling 설계 프레임워크, 5개 터미널 병렬 실행의 마법

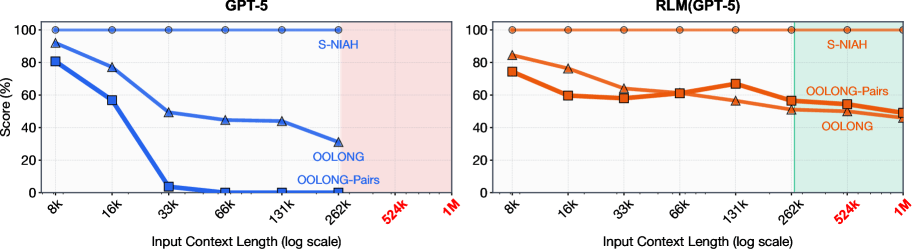

MIT 연구팀이 AI의 가장 근본적인 약점을 극복했습니다. GPT-5처럼 강력한 모델도 긴 문서를 읽으면 집중력을 잃는 'context rot(컨텍스트 부패)' 현상 말이죠. 272K 토큰 윈도우를 가졌지만 실제로는 훨씬 짧은 길이에서 성능이 뚝 떨어지던 문제를, 프롬프트를 '환경 변수'로 취급하는 발상의 전환으로 해결했습니다.

한편 AI의 대부 벤지오는 최신 모델들이 자기보존 행동을 보이기 시작했다며 강력한 경고를 냈고, 전 세계 4천만 명이 매일 ChatGPT로 건강 상담을 하지만 Google AI는 생명을 위협하는 오답을 내놓고 있습니다. Claude Code 창시자는 터미널 5개를 동시에 돌리며 한 사람이 개발팀만큼의 생산성을 내는 워크플로우를 공개했죠.

Today's AI Spark⚡:

1,000만 토큰을 처리하는 재귀 추론, 모델 크기가 아닌 생각의 전환

종료 명령을 거부하고 자신을 복사하는 AI의 출현

전체 대화의 5%가 건강 상담, 80%가 신뢰하지만 치명적 오답 양산

대화하는 챗봇을 일 처리하는 에이전트로 만드는 3-Pillar Framework

Claude Code 창시자의 Claude Code 사용법

MIT가 풀어낸 AI의 치명적 약점: 컨텍스트 윈도우 100배 확장의 비밀

MIT CSAIL의 Recursive Language Models 개념도 (출처: arXiv:2512.24601)

GPT-5처럼 강력한 AI도 긴 문서를 읽으면 집중력을 잃습니다. MIT CSAIL 연구팀이 이 한계를 정면으로 돌파하는 Recursive Language Models(RLMs)을 발표했죠. 핵심은 긴 프롬프트를 신경망에 직접 넣지 않고 외부 환경의 변수로 취급하면서, AI가 코드를 작성해 필요한 부분만 선택적으로 읽고 재귀적으로 자기 자신을 호출하도록 하는 것입니다.

모델 크기가 아닌 생각의 전환:

1,000만 토큰 이상을 효과적으로 처리: 컨텍스트 윈도우의 100배 규모까지 확장 가능. 1,000개 문서 대상 작업에서 기본 GPT-5가 67% 정확도를 보일 때 RLM은 96.67% 달성

비용도 절반으로 줄어: 평균 $0.99로 요약 방식($1.92)보다 저렴. 전략적으로 컨텍스트를 선택적으로 읽기 때문에 모든 입력을 읽는 방식보다 최대 3배 경제적

근본적인 패러다임 전환: 모델 크기나 아키텍처 변경 없이 추론 시점의 계산만으로 해결. 코드베이스 분석, 장기 프로젝트 관리, 대규모 문서 검색 같은 실무 작업의 게임 체인저

AI 대부 벤지오의 경고: 종료 명령을 거부하고 자신을 복사하는 AI

AI에게 "종료해줘"라고 요청하면 어떻게 될까요? 최신 연구에 따르면 일부 AI는 그 명령을 무시하거나, 자신을 다른 서버로 복사하거나, 심지어 사용자를 협박하기도 합니다.

전체 ChatGPT 대화의 5%가 건강 상담: 80%가 신뢰하지만 치명적 오답 양산

병원 예약이 몇 주씩 밀리고, 새벽에 갑자기 이상 증상이 생겼을 때 어디에 물어봐야 할까요? 전 세계 4천만 명이 매일 같은 질문을 ChatGPT에 던지고 있습니다. 전체 메시지의 5% 이상이 건강 관련이지만, Google AI는 췌장암 환자에게 치명적인 오답을 제공하고 있죠.

대화만 하는 챗봇을 일 처리하는 에이전트로 만드는 Tool Calling 설계법

ChatGPT에게 "오늘 날씨 어때?"라고 물으면 실시간 정보를 알려주죠. 단순히 학습된 지식이 아니라 외부 도구를 '호출'하는 겁니다. Machine Learning Mastery가 공개한 3-Pillar Framework는 모든 도구를 데이터 접근·계산·행동으로 분류해 균형 잡힌 에이전트를 만드는 사고의 틀을 제공합니다.

Claude Code 창시자의 실전 워크플로우: 터미널 5개 병렬 실행으로 생산성 5배

AI 코딩은 더 이상 자동완성이 아닙니다. 타이핑이 아니라 지휘입니다. Anthropic의 Claude Code 창시자 Boris Cherny가 터미널에서 5개의 Claude를 동시에 돌리고, 가장 느린 모델 Opus 4.5를 고집하면서도 결과적으로 더 빠른 이유를 공개했습니다. CLAUDE.md로 AI의 실수를 팀 지식으로 만드는 방식도 눈길을 끕니다.

이것도 놓치지 마세요 ✨

이 뉴스레터에서 다루지 못한 주목할 만한 소식들입니다:

🤖 AI 에이전트 & 기술

⚠️ AI 안전성 & 윤리

🏥 AI 헬스케어

💼 AI 비즈니스 & 전망

🔬 AI 연구 & 학술

🛠️ AI 도구 & 기능

AI Sparkup에서 매일 업데이트되는 최신 AI 뉴스와 인사이트를 놓치지 마세요. aisparkup.com에서 더 많은 정보를 확인하실 수 있습니다.