- AI Sparkup

- Posts

- Kimi K2 Thinking이 GPT-5를 이긴 날, AI 판도가 바뀌다 ⚡

Kimi K2 Thinking이 GPT-5를 이긴 날, AI 판도가 바뀌다 ⚡

PLUS: AI 코딩 생산성 신화의 진실, 필즈상 수상자의 AI 수학 실험, 엔비디아 CEO의 급선회, Transformer를 넘어서는 5가지 아키텍처

중국 스타트업 Moonshot AI의 Kimi K2 Thinking이 AI 업계의 판도를 뒤집었습니다. 1조 파라미터 오픈소스 모델이 GPT-5와 Claude 4.5 Sonnet을 제치고 추론 벤치마크 1위를 차지한 거죠. 더 놀라운 건 훈련비 460만 달러, API 가격은 GPT-5의 10분의 1이라는 파괴적 가성비입니다.

한편 Google이 2년간 추적한 AI 코딩 데이터는 "70% 빠르게, 30%는 여전히 어렵다"는 현실을 보여주며 생산성 신화를 깨뜨렸고, 필즈상 수상자는 AI로 300년 묵은 수학 난제를 개선했습니다. AI 기술의 본질적 변화가 동시다발적으로 일어나고 있습니다.

Today's AI Spark⚡:

오픈소스가 상용 모델을 제치는 새로운 시대

Google이 발견한 AI 코딩의 70% 함정

300년 수학 난제를 돌파한 AI의 진짜 실력

엔비디아 CEO의 발언과 몇 시간 후의 번복

Transformer 독주를 끝낼 5가지 대안 아키텍처

1조 파라미터 오픈소스가 GPT-5를 제친 날: Kimi K2 Thinking의 충격

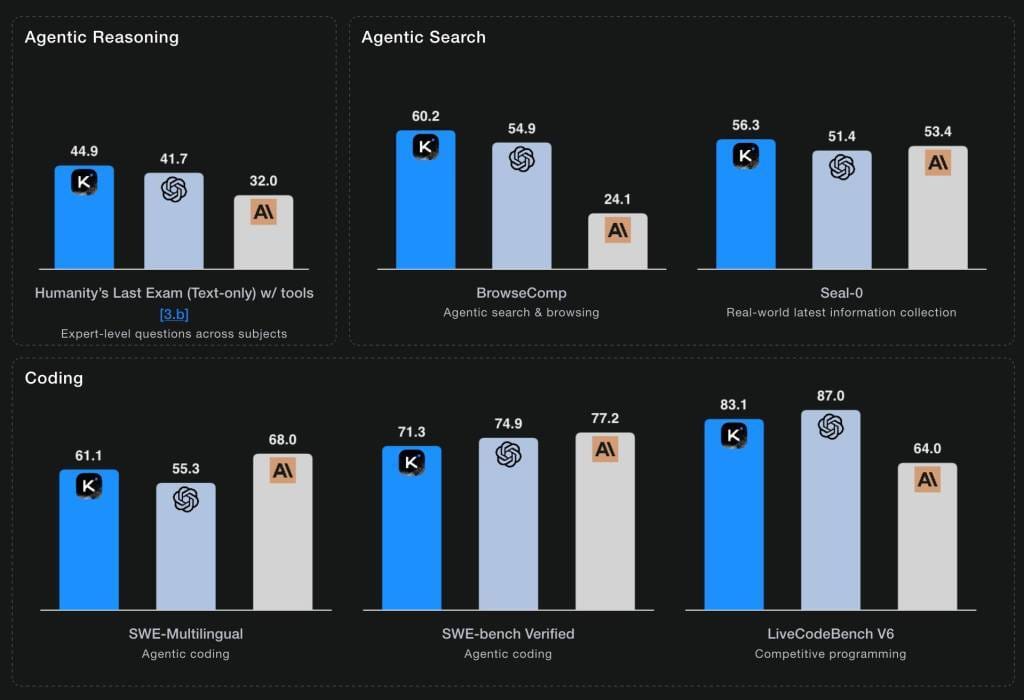

Kimi K2 Thinking의 벤치마크 성능 (출처: Simon Willison 블로그)

오픈소스 AI가 OpenAI나 Anthropic 같은 거대 기술 기업의 상용 모델과 진짜 경쟁할 수 있을까요? 중국의 스타트업 Moonshot AI가 그 질문에 명확한 답을 내놨습니다. 1조 파라미터 규모의 추론 전문 AI 모델이 GPT-5와 Claude를 제치고, API 가격은 10분의 1 수준이라는 파괴적 가성비로 등장한 거죠.

압도적 추론 능력과 믿기 힘든 가성비:

GPT-5를 제친 벤치마크: Humanity's Last Exam(HLE)에서 44.9% 기록하며 GPT-5(41.7%), Claude(32.0%) 모두 제압. 웹 검색 포함 에이전트 작업 BrowseComp에서는 60.2%로 GPT-5(54.9%)와 Claude(24.1%)를 압도

훈련비 460만 달러의 충격: 1조 파라미터 규모 모델을 460만 달러로 훈련. API 가격은 입력 토큰 100만 개당 0.60달러, 출력 2.50달러로 GPT-5(입력 1.25달러, 출력 10달러)의 10분의 1 수준. INT4 양자화로 594GB까지 압축해 Mac Studio 2대로도 실행 가능

Modified MIT 라이선스 오픈소스: 상업적 사용 가능한 오픈소스로 공개. 256,000 토큰 컨텍스트 창 지원하고 인간 개입 없이 200~300회 연속 도구 호출 가능. 각 추론 단계마다 중간 논리 과정 투명하게 노출

AI 코딩의 70% 함정: Google이 발견한 생산성 신화의 진실

Google Chrome Developer Experience 팀이 2년간 추적한 데이터가 AI 코딩의 현실을 드러냈습니다. 전체 코드의 30% 이상을 AI가 생성하지만 개발자 신뢰도는 70%에서 60%로 오히려 떨어졌다는 겁니다. "10배 생산성"은 신화였고, 실제는 1-2배 수준이라는 게 Google의 솔직한 고백이죠.

70%는 빠르게, 나머지 30%는 여전히 어렵다:

신뢰도 하락의 역설: 채택률은 증가하는데 신뢰도는 70%→60%로 하락. 약 30% 개발자가 AI 생성 코드를 거의 또는 전혀 신뢰하지 않음. 버그 하나 고치려다 두 개가 생기는 "두 걸음 후퇴 패턴" 빈번

과장된 생산성 신화: 트위터에서 자랑하는 10배 생산성은 대부분 기술 부채 없는 그린필드 프로젝트. 현실의 레거시 시스템에선 1-2배 향상이 일반적이고, 작업 완료율은 20% 정도 증가 수준

코드 리뷰가 새 병목: AI가 빠르게 코드를 쏟아내니 리뷰할 코드가 급증. "AI가 코드를 생성하고 AI가 테스트하고 AI가 코드 리뷰까지 하면... 이제 무슨 일이 일어나는지 아무도 모르게 됩니다"

필즈상 수상자가 AI로 67개 문제 푼 결과: 300년 난제도 개선

필즈상 수상자 테렌스 타오 교수가 직접 나섰습니다. Google DeepMind의 AlphaEvolve로 67개 수학 문제를 테스트하고, 모든 성공과 실패를 투명하게 공개한 거죠. AI가 300년간 수학자들을 괴롭혀온 키싱 넘버 문제에서 새로운 하한을 제시하며 진짜 과학적 발견 능력을 입증했습니다.

AI가 코드를 진화시켜 수학 난제를 돌파:

75% 재발견, 20% 개선: 67개 문제 중 75%에서 기존 최선의 해답 재발견. 약 20%에서는 기존 최고 기록 넘어섬. LLM과 진화 알고리즘을 결합해 코드를 수백 번 반복 개선하며 점차 나은 해답 발견

300년 묵은 키싱 넘버 돌파: 11차원 공간에서 593개 외부 구체가 중심 구체에 동시 접촉하는 배치 발견. 이전 최고 기록 592개를 1개 넘어섬. 4×4 복소수 행렬 곱셈도 48회로 줄여 1969년 슈트라센 알고리즘 개선

수학자와 AI의 새 협력 방식: 문제 정의와 평가 방법은 수학자가 설계하고, AI는 방대한 탐색 공간을 빠르게 훑으며 해답 발견. Google은 이미 데이터센터 스케줄링 알고리즘 개선해 전 세계 컴퓨팅 자원의 0.7% 추가 확보

엔비디아 CEO의 고백과 몇 시간 후의 번복: 미중 AI 전쟁의 역설

"중국이 AI 경쟁에서 이길 것입니다." 엔비디아 CEO 젠슨 황의 이 한 마디는 실리콘밸리에 충격파를 보냈습니다. 하지만 몇 시간 후 엔비디아는 "중국은 미국보다 나노초 뒤처져 있다"며 급히 입장을 바꿨죠. 이 번복 뒤에는 미국의 칩 수출 제재가 오히려 중국의 기술 자립을 가속화한 뼈아픈 현실이 숨어 있습니다.

제재가 만든 역설적 결과:

시장 점유율 제로로 추락: 엔비디아는 한때 데이터센터 매출의 20-25%를 중국에서 올렸지만 현재는 "제로". 중국은 올해 11월 국가 자금 받는 데이터센터에서 엔비디아, AMD, 인텔 AI 칩 사용 전면 금지. 이미 설치된 칩도 공사 진행률 30% 미만이면 제거

1,000억 달러 투자로 자립 가속: 중국은 지난 2년간 데이터센터 건설에 1,000억 달러 이상 투자. 화웨이, 알리바바 등이 자체 AI 칩 개발하고 정부는 전력 보조금으로 자국 칩 쓰는 개발자들의 비용 낮춤

로비의 실패와 급선회: 황은 수개월간 중국 수출 제한 완화 로비했지만 트럼프-시진핑 무역 회담 실패로 무산. FT 인터뷰에서 미국의 "냉소주의"와 과도한 규제 비판했지만 몇 시간 만에 발언 수위 낮춤

표준 LLM을 넘어서: Transformer 독주를 끝낼 5가지 대안 아키텍처

GPT부터 Claude, Llama까지, 거의 모든 LLM은 2017년 Transformer 아키텍처를 기반으로 작동합니다. 검증됐고 안정적이지만 긴 문서 처리 시 메모리가 기하급수적으로 늘어나는 한계가 분명하죠. AI 연구자 Sebastian Raschka가 이 한계를 넘어서는 5가지 대안 아키텍처를 정리했습니다.

효율성과 혁신의 실험들:

Linear Attention 하이브리드: Qwen3-Next와 Kimi Linear가 Linear Attention과 Full Attention을 3:1 비율로 혼합. KV 캐시 75% 감소, 디코딩 속도 최대 6배 향상하면서도 장거리 맥락 이해 능력 유지

Text Diffusion 모델: 이미지 생성 기술을 텍스트에 적용. 단어를 순차적으로 생성 대신 모든 위치를 동시에 처리. 2,000개 단어를 2,000번이 아닌 20-60번의 디노이징 단계로 생성. Google Gemini Diffusion 등 새 흐름 시작

Code World Model: 코드를 단순 텍스트가 아닌 "실행 가능한 논리"로 이해. 코드 실행 결과를 예측하도록 학습해 32B 파라미터로 gpt-oss-20b와 대등한 성능. 일종의 내부 시뮬레이터 탑재

이것도 놓치지 마세요 ✨

이 뉴스레터에서 다루지 못한 주목할 만한 소식들입니다:

🛍️ AI 커머스 & 플랫폼

🗺️ AI 도구 & 서비스

🔧 AI 개발 & 기술

💼 AI 직업 & 산업

⚠️ AI 보안 & 의료

AI Sparkup에서 매일 업데이트되는 최신 AI 뉴스와 인사이트를 놓치지 마세요. aisparkup.com에서 더 많은 정보를 확인하실 수 있습니다.